プロダクト概要

製品の強み

適用シーン

マジックコマンド | 意味説明 | 使用例 |

%run | 指定されたPythonスクリプトまたはNotebookファイルを実行 |

|

%pip | 指定されたPythonパッケージをインストール |

|

マジックコマンド | 意味説明 | 使用例 |

%%python | 現在のセルをPython構文で実行します(通常は不要で、デフォルトはPythonです) |

|

%%markdown | セル内でMarkdownテキストをレンダリングします |

|

%load_ext dlcmagic.kyuubikernel.magics.dlcenginemagics%load_ext dlcmagic.pythonkernel.magics

マジックコマンド | 意味説明 | 使用例 |

%%py | 現在のセルをPySpark構文で実行します。使用前に以下の初期化コマンドを実行する必要があります |

|

%%scala | 現在のセルをScala構文で実行 |

|

%%sql | 現在のセルをSpark SQL構文で実行 |

|

関数名 | 意味説明 | 使用例 |

summarize(df: Object): void | DataFrameの統計指標を計算および表示し、データ構造を理解しやすくします。 Pythonコード、PySparkコードに適用されます。 |

|

関数名 | 意味説明 | 使用例 |

exit(value: String): void | 現在のnotebookを終了し、指定された戻り値を出力します。この方法でnotebookのパラメータを下流のタスクに渡すことができます。 |

|

run(path: String, timeoutSeconds: int, arguments: Map): String | ノートブックファイルを実行する path:notebookファイルのパスを指定します timeoutSeconds:タイムアウト時間 arguments:変数 |

|

関数名 | 意味説明 | 使用例 |

text(name: String, defaultValue: String, label: String): void | 変数の値を設定 |

|

get(name: String): String | 指定変数を取得 |

|

remove(name: String): void | 指定変数をクリア |

|

removeAll(): void | 現在のコンテキストに設定された変数をクリア |

|

MLFlow関数 | 関数名 | 関数の機能と使用方法 |

実験管理 | mlflow.create_experiment(name) | 新しい実験を作成します。 実験名の一意性を保証する必要があります。実験名が既に存在する場合、create_experimentは例外を発生させます。 |

| mlflow.set_experiment(name) | 現在の実験を設定します。 既存の実験名に直接使用でき、後続の実行でパラメータとメトリクスを記録することができます。 指定された実験が存在しない場合、新しい実験が自動的に作成されます。 |

| mlflow.start_run() | 新しい実行を開始します。 現在の実行コンテキストを表すRunオブジェクトを返します。 start_run() は通常、with ステートメントと一緒に使用され、実行終了時に自動的に end_run() が呼び出されるようにします。 |

パラメータと指標を記録する | mlflow.log_param(key, value) | パラメータとその値を記録する key (str): パラメータの名前。 value (str, int, float): パラメータの値。文字列、整数、または浮動小数点数を指定できます。 |

| mlflow.log_metric(key, value, step=None) | 指標とその値を記録する。 |

| mlflow.log_artifact(local_path, artifact_path=None) | ローカルファイルまたはディレクトリ(モデルの設定ファイル、データファイル、結果ファイルなど)を記録する。 local_path:記録するローカルファイルまたはディレクトリのパス; artifact_path:MLflowサーバー上でこのファイルまたはディレクトリを保存するパス。 |

モデル管理 | mlflow.sklearn.log_model(model, artifact_path) | Scikit-learnモデルを記録します。 |

| mlflow.pyfunc.log_model(artifact_path, python_model) | カスタムPythonモデルを記録します。 |

| mlflow.register_model(model_uri, name) | モデルをモデルレジストリに登録します。モデルレジストリはMLflowが提供するモデル管理とバージョン管理機能で、モデルの共有、デプロイ、管理を容易にします。 |

モデルデプロイ | mlflow.pyfunc.serve(model_uri) | モデルをREST APIサービスとしてデプロイします。登録されたMLflowモデルの予測サービスを提供するために、ローカルでHTTPサーバーを起動します。サーバー起動後、HTTP Postリクエストでデータを送信して予測を行うことができます。 model_uri:登録済みモデルを指すURIで、モデルレジストリ内のURIまたは記録済みモデルのパスを指定できます。 |

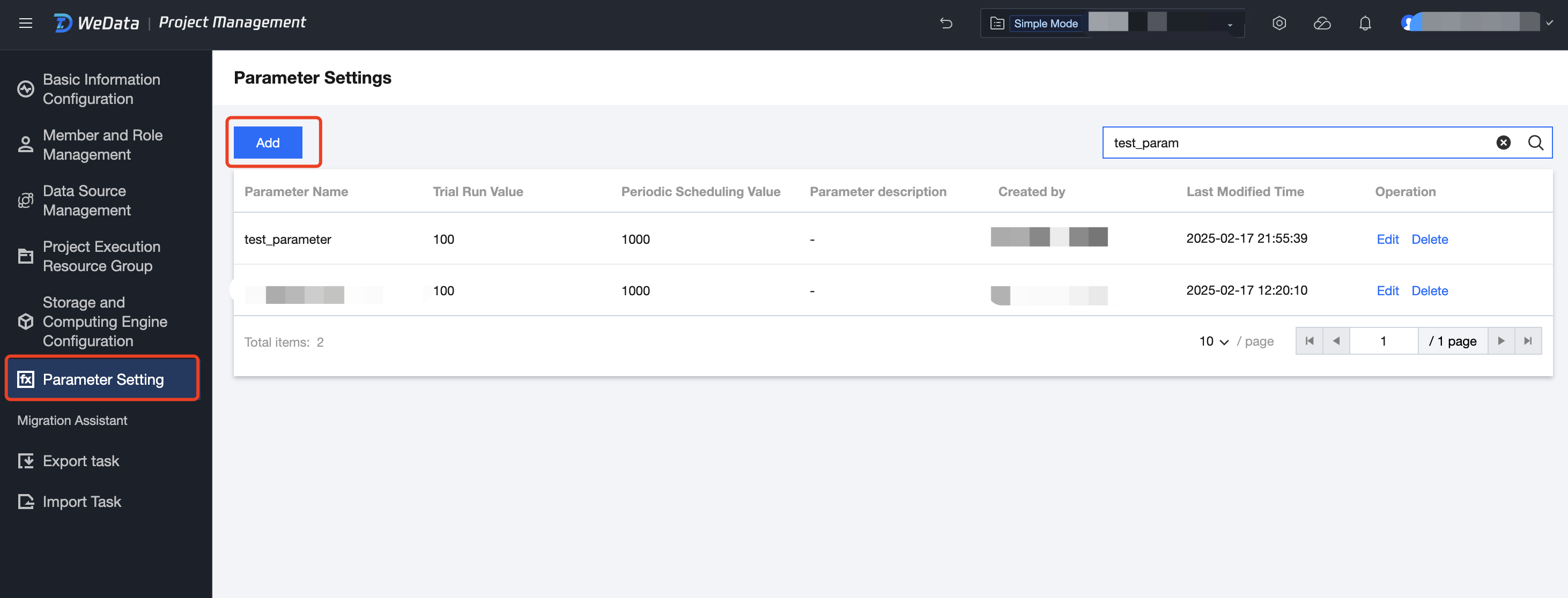

# print project parametersprint(dlcutils.params.get("test_parameter"))# output 100

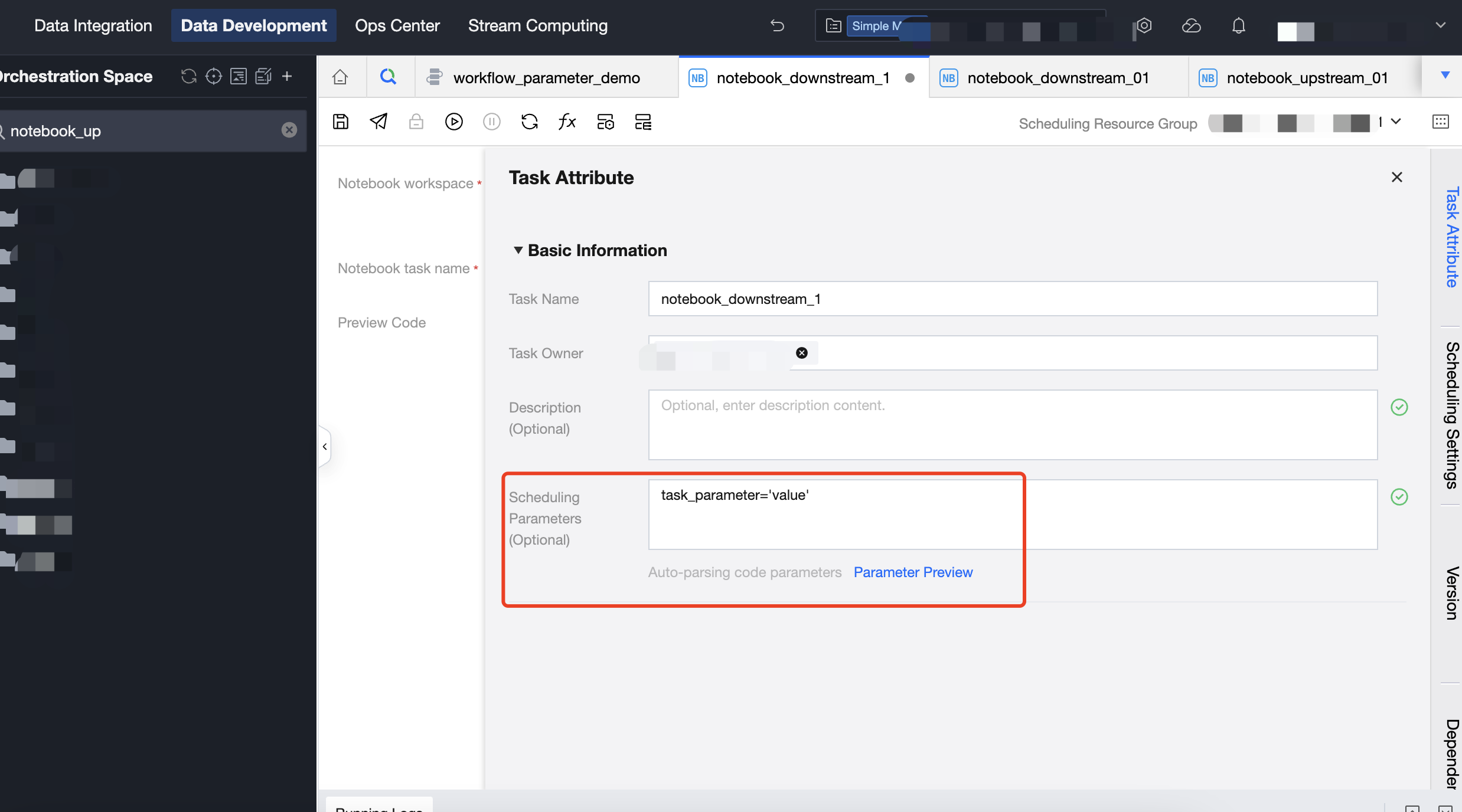

# get task_test_param value# When testing and running in the notebook space,# default values need to be set because the notebook file has not yet been associated with a task.try:task_test_param_value = dlcutils.params.get("task_test_param")if not task_test_param_value: # 取得した値が空文字列の場合task_test_param_value = 'task_default_value'except Exception: # パラメータを完全に取得できない場合task_test_param_value = 'task_default_value'print(f"Using toy value: {task_test_param_value}")

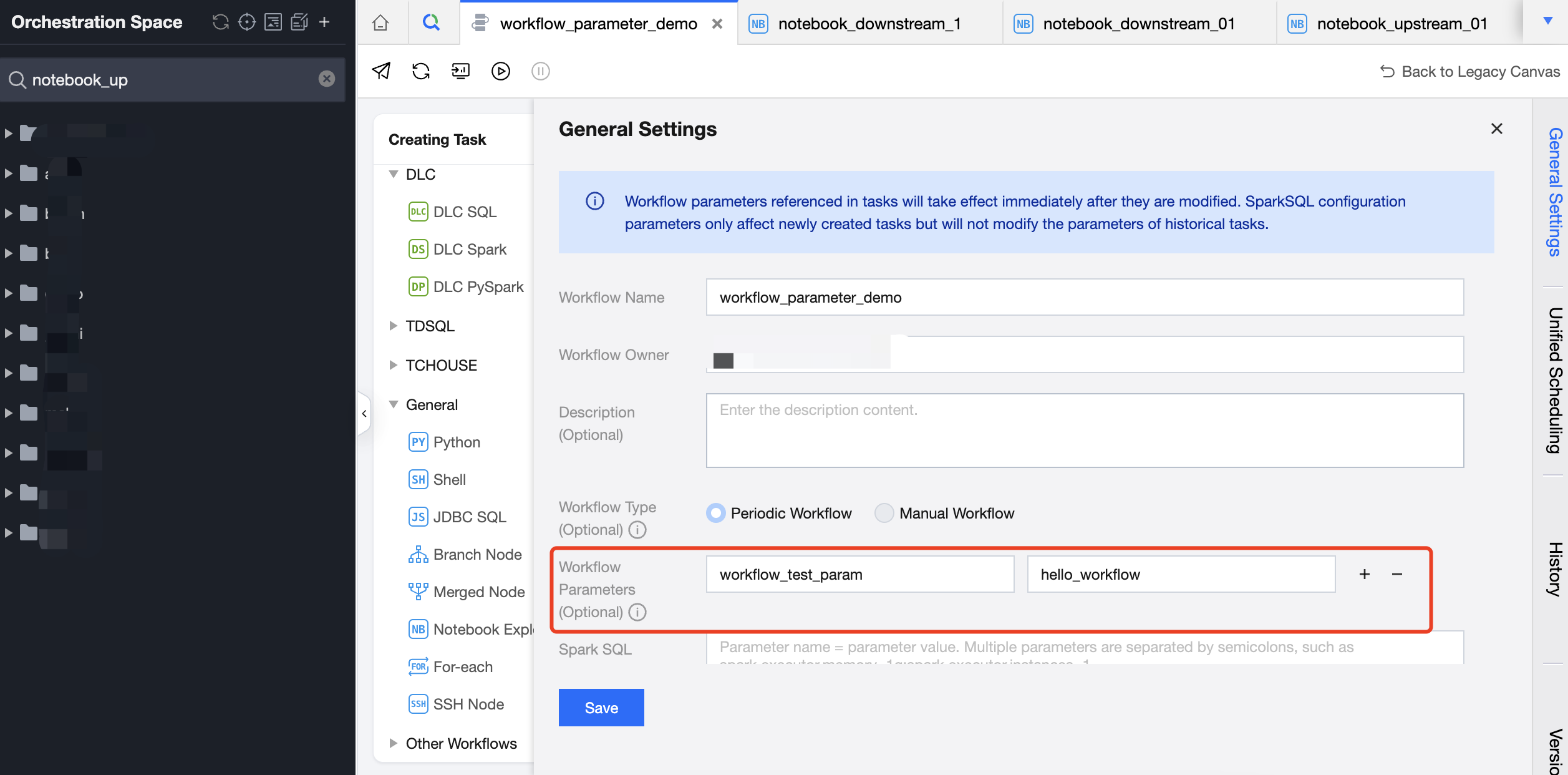

# get workflow_test_param value# When testing and running in the notebook space,# default values need to be set because the notebook file has not yet been associated with a workflow.try:workflow_test_param_value = dlcutils.params.get("workflow_test_param")if not workflow_test_param_value: # 取得した値が空文字列の場合workflow_test_param_value = 'workflow_default_value'except Exception: # パラメータを完全に取得できない場合workflow_test_param_value = 'workflow_default_value'print(f"Using toy value: {workflow_test_param_value}")

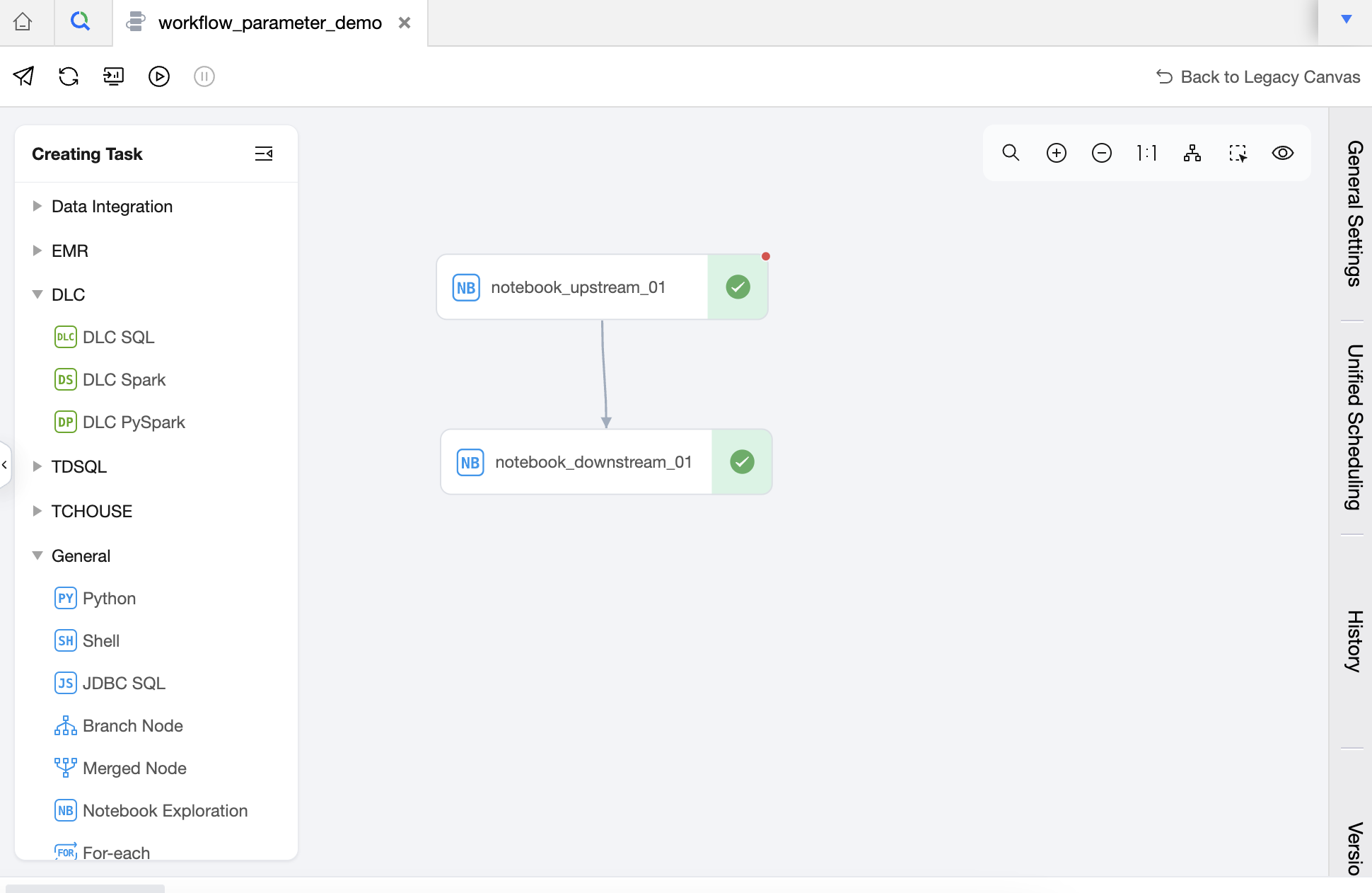

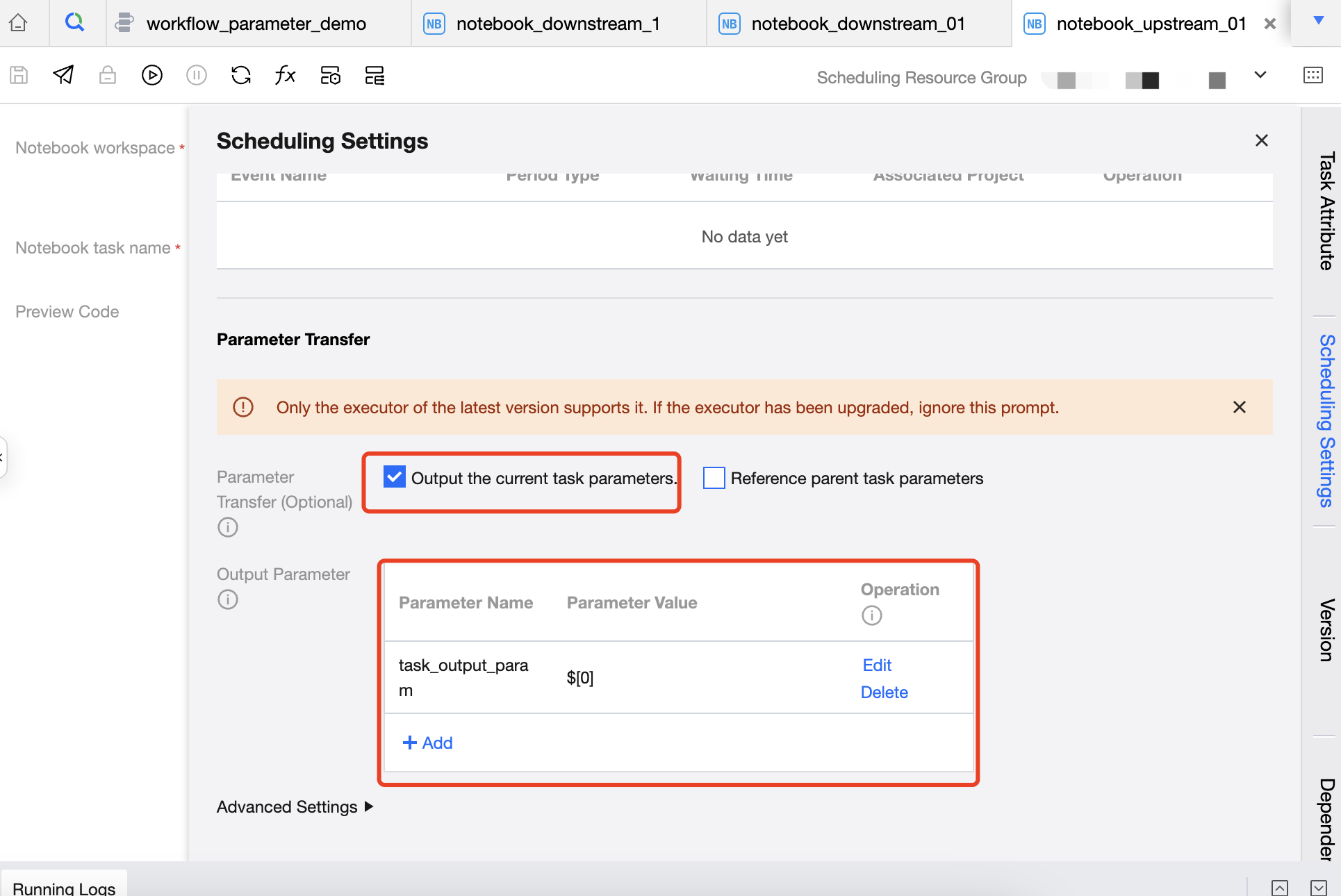

# Exit the notebook and output parametersdlcutils.notebook.exit('this is output parameter values')

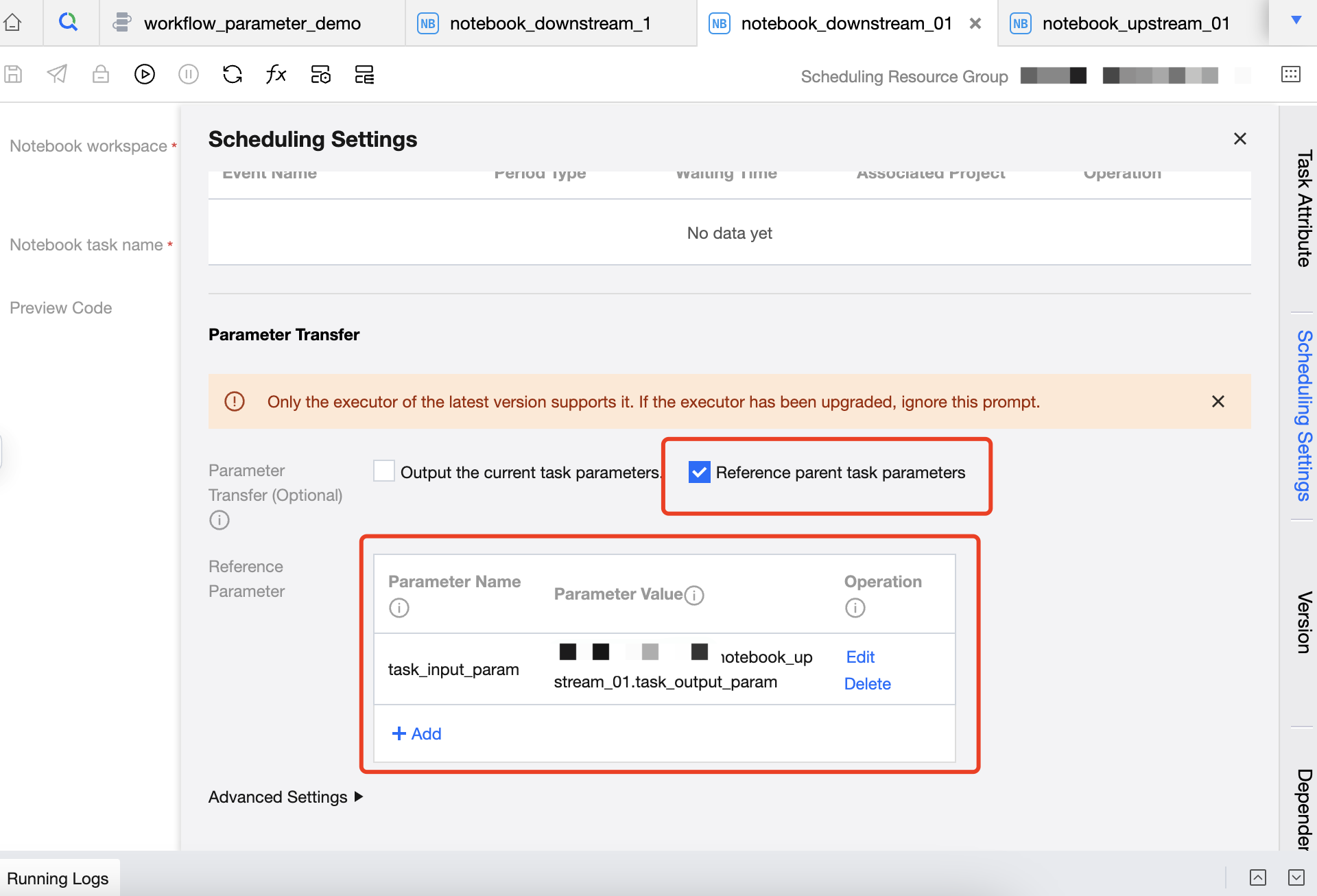

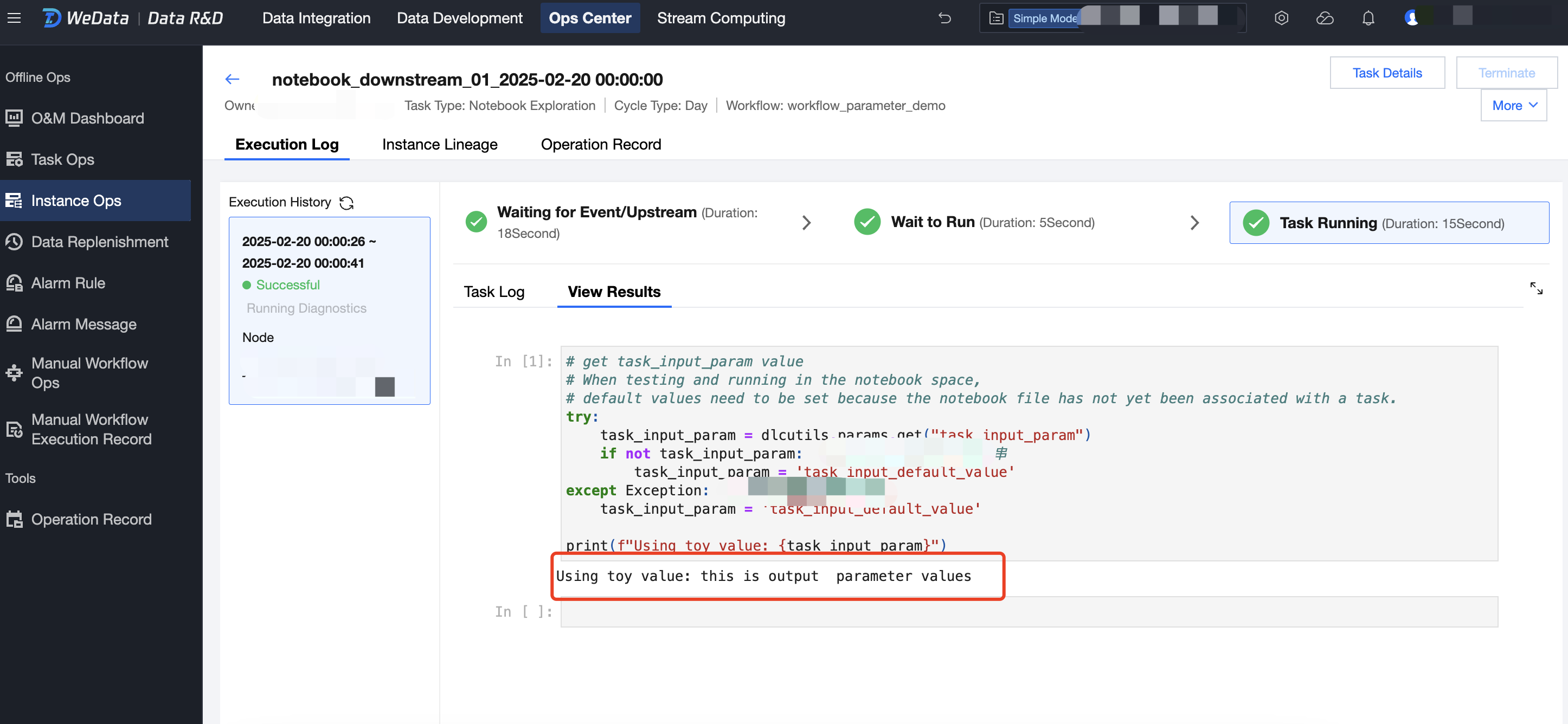

# get task_input_param value# When testing and running in the notebook space,# default values need to be set because the notebook file has not yet been associated with a task.try:task_input_param = dlcutils.params.get("task_input_param")if not task_input_param: # 取得した値が空文字列の場合task_input_param = 'task_input_default_value'except Exception: # パラメータを完全に取得できない場合task_input_param = 'task_input_default_value'print(f"Using toy value: {task_input_param}")

フィードバック