- 动态与公告

- 产品简介

- 购买指南

- 快速入门

- 操作指南

- CKafka 连接器

- 最佳实践

- 故障处理

- API 文档

- History

- Introduction

- API Category

- Making API Requests

- DataHub APIs

- ACL APIs

- Topic APIs

- BatchModifyGroupOffsets

- BatchModifyTopicAttributes

- CreateConsumer

- CreateDatahubTopic

- CreatePartition

- CreateTopic

- CreateTopicIpWhiteList

- DeleteTopic

- DeleteTopicIpWhiteList

- DescribeDatahubTopic

- DescribeTopic

- DescribeTopicAttributes

- DescribeTopicDetail

- DescribeTopicProduceConnection

- DescribeTopicSubscribeGroup

- FetchMessageByOffset

- FetchMessageListByOffset

- ModifyDatahubTopic

- ModifyTopicAttributes

- DescribeTopicSyncReplica

- Instance APIs

- Route APIs

- Other APIs

- Data Types

- Error Codes

- SDK 文档

- 通用参考

- 常见问题

- 服务等级协议

- 联系我们

- 词汇表

- 动态与公告

- 产品简介

- 购买指南

- 快速入门

- 操作指南

- CKafka 连接器

- 最佳实践

- 故障处理

- API 文档

- History

- Introduction

- API Category

- Making API Requests

- DataHub APIs

- ACL APIs

- Topic APIs

- BatchModifyGroupOffsets

- BatchModifyTopicAttributes

- CreateConsumer

- CreateDatahubTopic

- CreatePartition

- CreateTopic

- CreateTopicIpWhiteList

- DeleteTopic

- DeleteTopicIpWhiteList

- DescribeDatahubTopic

- DescribeTopic

- DescribeTopicAttributes

- DescribeTopicDetail

- DescribeTopicProduceConnection

- DescribeTopicSubscribeGroup

- FetchMessageByOffset

- FetchMessageListByOffset

- ModifyDatahubTopic

- ModifyTopicAttributes

- DescribeTopicSyncReplica

- Instance APIs

- Route APIs

- Other APIs

- Data Types

- Error Codes

- SDK 文档

- 通用参考

- 常见问题

- 服务等级协议

- 联系我们

- 词汇表

操作场景

Datahub 提供数据流出能力,您可以将 CKafka 数据分发至分布式数据仓库 TDW 以对数据进行存储、查询和分析。

前提条件

该功能目前依赖分布式数据仓库(TDW)产品,使用时需开通相关产品功能。

操作步骤

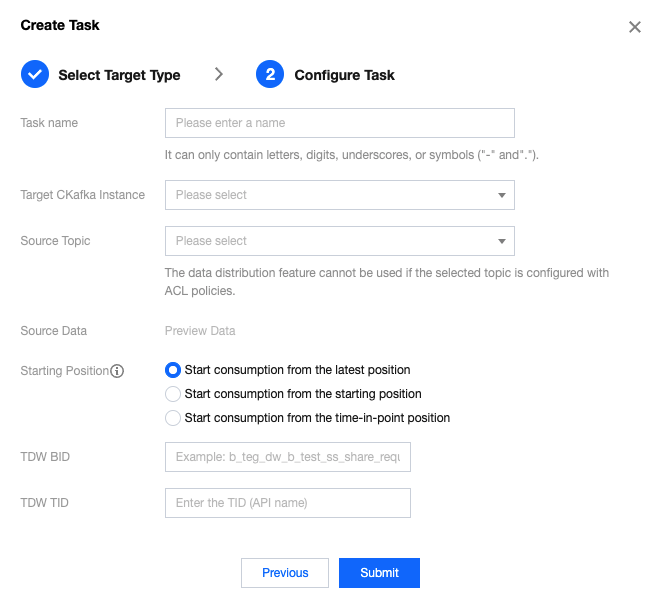

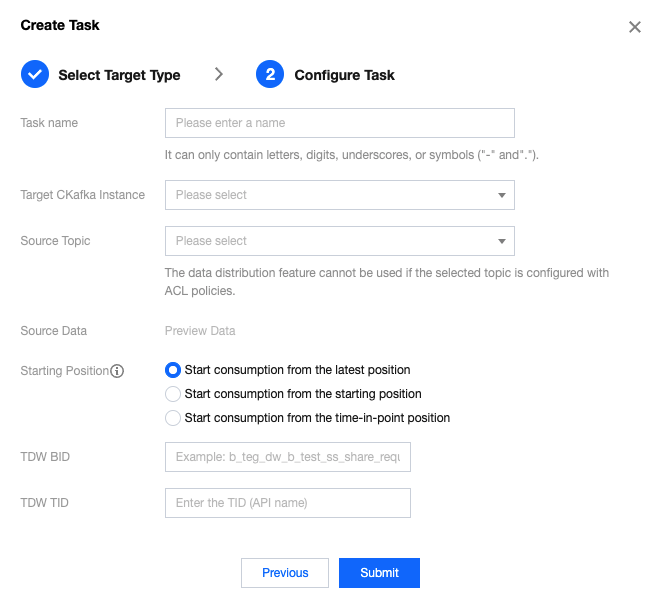

创建任务

1. 登录 CKafka 控制台 。

2. 在左侧导航栏单击数据流出,选择好地域后,单击新建任务。

3. 目标类型选择分布式数据仓库(TDW),单击下一步。

任务名称:只能包含字母、数字、下划线、"-"、"."。

CKafka 实例:选择数据源 CKafka。

源 Topic:选择源 Topic。

源数据:支持拉取源数据。

起始位置:转储时历史消息的处理方式,topic offset 设置。

TDW BID:填写 TDW 业务 BID。

TDW TID:填写 TDW 业务 TID。

4. 单击提交,完成任务创建。

查看监控

1. 登录 CKafka 控制台 。

2. 在左侧导航栏单击数据流出,单击目标任务的 ID,进入任务基本信息页面。

3. 在任务详情页顶部,单击监控,选择要查看资源,设置好时间范围,可以查看对应的监控数据。

更改数据源和数据目标

1. 登录 CKafka 控制台 。

2. 在左侧导航栏单击数据流出,单击目标任务的 ID,进入任务基本信息页面。

3. 单击数据源模块右上角的更改数据源,修改数据源信息。

4. 单击数据目标模块右上角的更改数据目标,修改数据目标信息。

说明:

更改数据目标,不会重置消费组 offset。

任务暂停过程中,不支持修改数据源和数据目标。

产品限制和费用计算

转储速度与 CKafka 实例峰值带宽上限有关,如出现消费速度过慢,请检查 CKafka 实例的峰值带宽或增加 CKafka partition 数。

转储速度与 CKafka 单个文件大小相关,如超过该500M,会自动分包上传。

是

是

否

否

本页内容是否解决了您的问题?