用量统计

下载

聚焦模式

字号

功能概述

服务维度:查看特定在线推理服务的用量。

模型维度:查看每个模型的调用量、Token 消耗及免费额度。

Key 维度:查看不同 API Key 的调用情况。

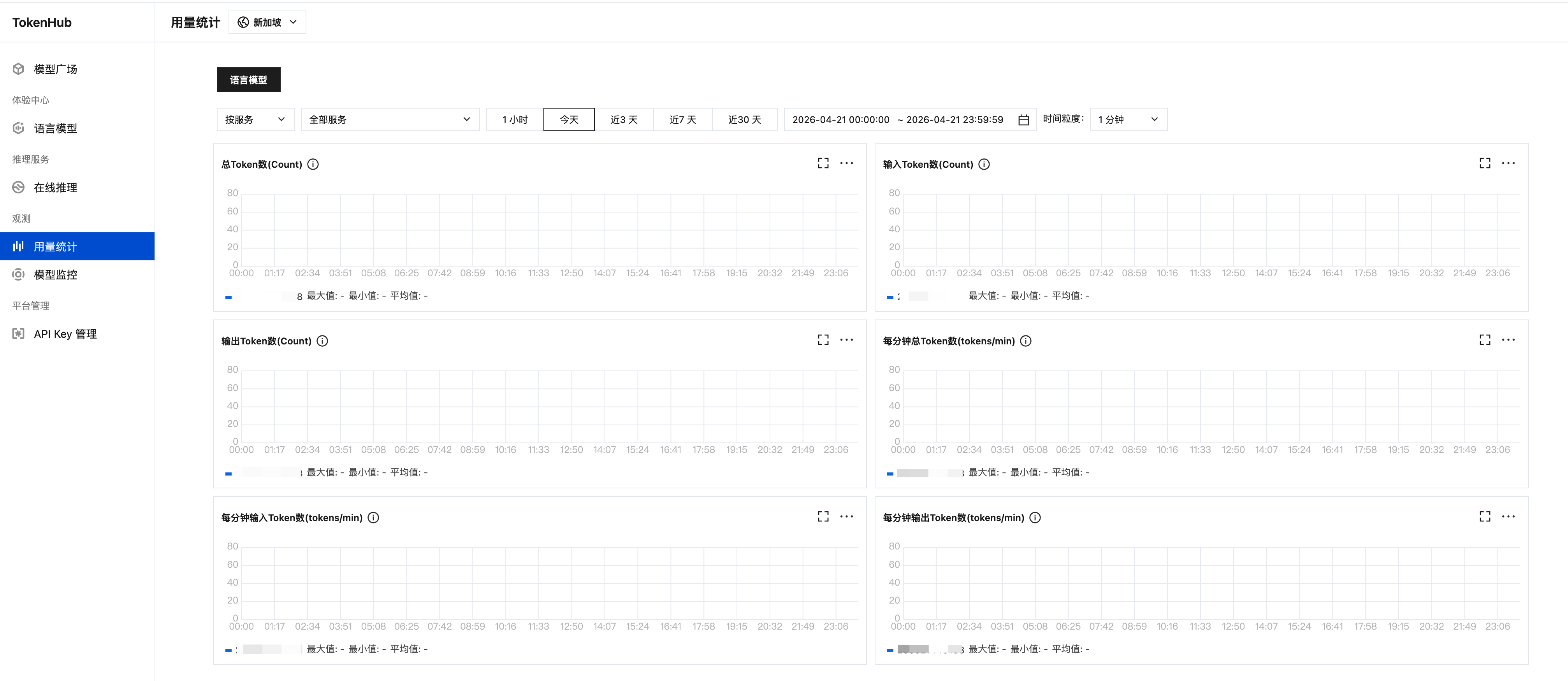

模型用量

按模型维度汇总调用数据,支持按模型类型分类查看。

分类筛选

页面顶部提供分类标签,快速筛选不同模型类型,同时支持按在线推理服务、API Key 筛选,查看特定服务的调用情况。

模型类型 | 包含模型 |

语言模型 | DeepSeek V3.2、GLM-5、GLM-5.1、GLM-5V-Turbo、GLM-5-Turbo、kimi-k2.5、MiniMax-M2.5、MiniMax-M2.7 |

调用指标

各模型在选定时间范围内的关键调用指标,统计粒度支持 1分钟 / 5分钟 / 1小时:

字段 | 模型类型 | 说明 |

总 Token 数 | 文本生成 | 输入 Token 数 + 输出 Token 数。 |

输入 Token 数 | | 请求(Prompt)部分消耗的 Token 数量。 |

输出 Token 数 | | 模型响应(Completion)部分消耗的 Token 数量。 |

每分钟总 Token 数 | | 每分钟输入 Token 数 + 每分钟输出 Token 数。 |

每分钟输入 Token 数 | | 每分钟输入侧的 Token 吞吐量(tokens/min)。 |

每分钟输出 Token 数 | | 每分钟输出侧的 Token 吞吐量(tokens/min)。 |

用量趋势图

以可视化图表呈现调用趋势,每项指标均提供最大值、最小值、平均值三项统计摘要,帮助用户快速识别用量峰值与整体趋势。

文本生成

提供六项 Token 维度的趋势监控:

Token 消耗趋势:总 Token 数 / 输入 Token 数 / 输出 Token 数随时间的变化走势

Token 吞吐趋势:每分钟总 Token 数 / 每分钟输入 Token 数 / 每分钟输出 Token 数的并发量变化

文档反馈